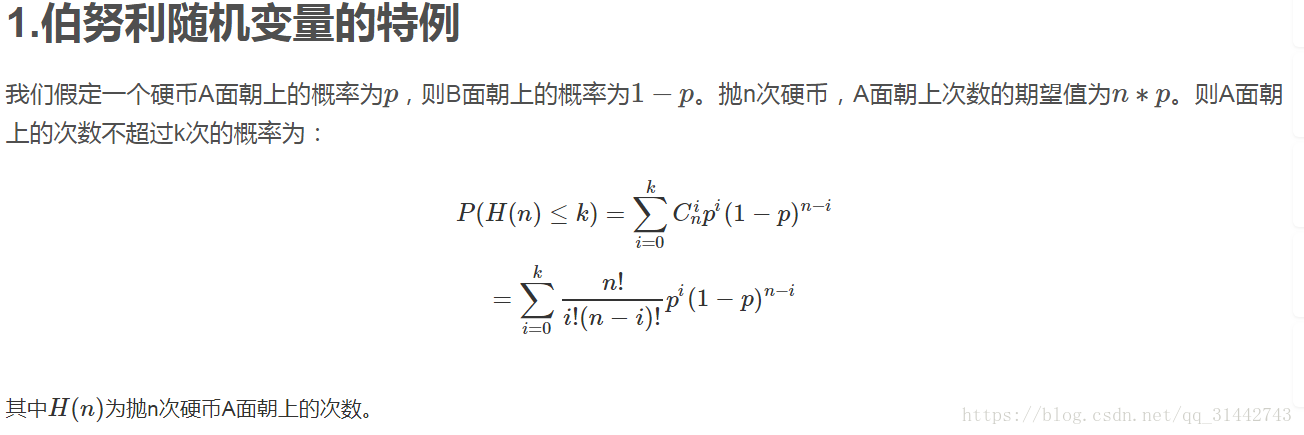

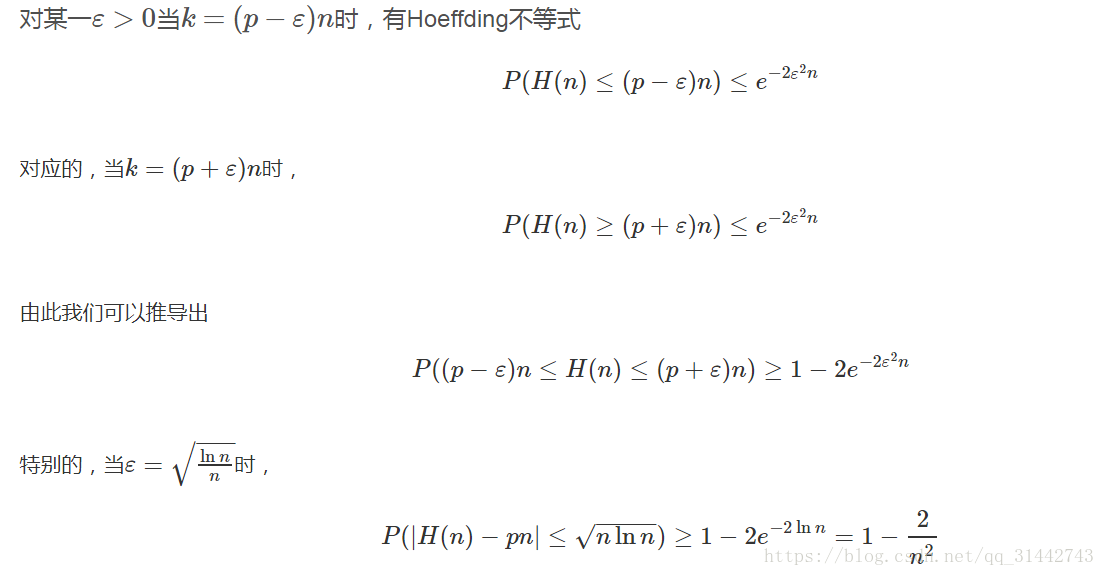

Hoeffding霍夫丁不等式

机器学习中,算法的泛化能力往往是通过研究泛化误差的概率上界所进行的,这个就称为泛化误差上界。直观的说,在有限的训练数据中得到的规律,则认为真实的总体数据中也是近似这个规律的。比如一个大罐子里装满了红球和白球,各一半,我随手抓了一把,然后根据这些红球白球的比例预测整个罐子也是这样的比例,这样做不一定很准确,但结果总是近似的,而且如果抓出的球越多,预测结果也就越可信。

对于两种不同的学习方法,通常比较他们的误差上界来决定他们的优劣。hoeffding不等式于1963年被Wassily Hoeffding提出并证明,用于计算随机变量的和与其期望值偏差的概率上限。下面我们理清hoeffding 不等式的来龙去脉。

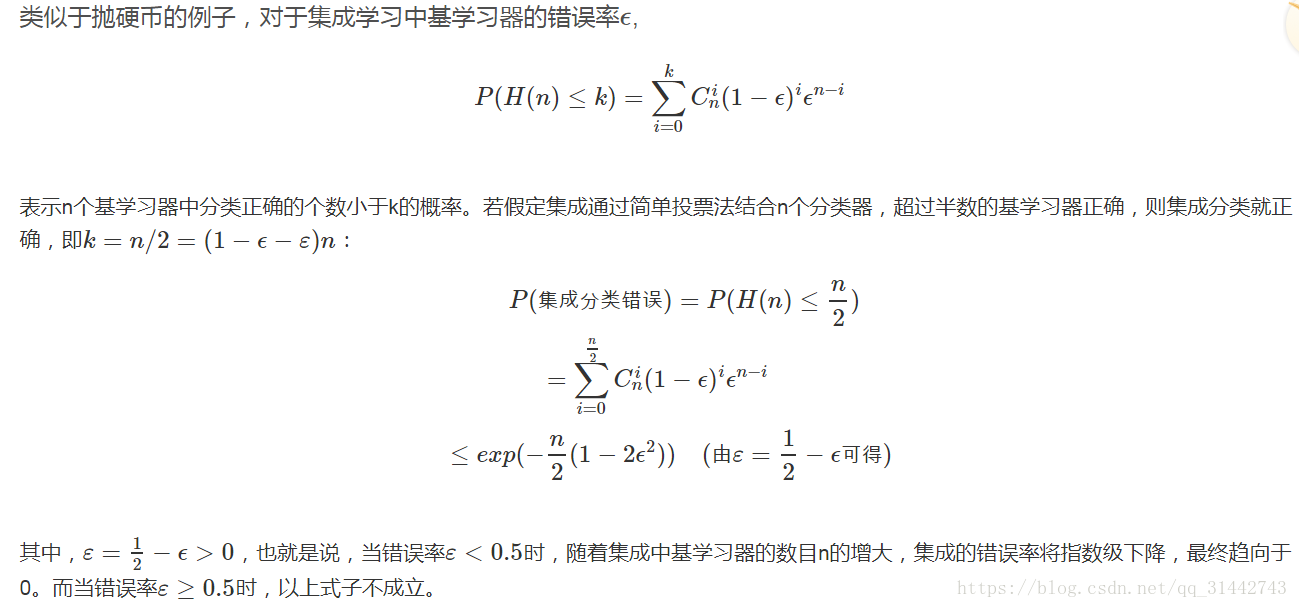

2.集成学习的错误率上界

点击查看更多内容

为 TA 点赞

评论

共同学习,写下你的评论

评论加载中...

作者其他优质文章

正在加载中

感谢您的支持,我会继续努力的~

扫码打赏,你说多少就多少

赞赏金额会直接到老师账户

支付方式

打开微信扫一扫,即可进行扫码打赏哦