①课程介绍

课程名称:Python3入门机器学习 经典算法与应用 入行人工智能

课程章节:9-1;9-2;9-3

主讲老师:liuyubobobo

内容导读

- 第一部分 逻辑回归介绍

- 第二部分 逻辑回归原理

- 第三部分 逻辑回归实现

②课程详细

第一部分 逻辑回归介绍

- 逻辑回归算法应用场景很多,主要用于分类算法

- 将样本的特征和样本发生的概率联系起来

- 因为逻辑回归使用的是样本发生的概率,所以可以看作是回归算法,也可以看作是分类算法,通常用于解决分类算法,二分类问题

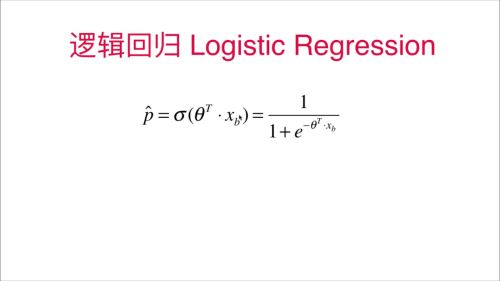

第二部分 逻辑回归原理

逻辑回归和线性回归有点像,应为他是预测概率,将y_hat值域范围在负无穷到正无穷,外面套一个sigima函数,变成0-1的数据,然后就使y_hat的值在0-1之间,通过调节判断条件来决定y_hat>多少判断为1,小于多少判断为0,如此就将回归问题变成了一个分类问题。

第三部分 逻辑回归实现的框架

class LogisticRegression:

def __init__(self):

"""初始化多元线性回归模型"""

# 初始化截距coef_和系数interception_,和theta私有化参数

self.coef_ = None

self.intercept_ = None

self._theta = None

#定义一个sigimod函数

def _sigmoid(self, X):

return 1. / (1. + np.exp(-X))

#进行拟合参数

def fit(self, X_train, y_train, eta=0.01, n_iters=1e4, epsilon=1e-8 ):

assert X_train.shape[0] == y_train.shape[0],\

"the size of X_train must be equal to the size of y_train"

assert n_iters >= 1,\

"n_iters must big to 1"

assert len(y_train) == (len(y_train[y_train==1]) + len(y_train[y_train==0])),\

"the y must 1 or 0"

def J(theta, X_b, y):

y_had = self._sigmoid(X_b.dot(theta))

try:

return -np.sum(y * np.log(y_had) + (1 - y) * np.log(1 - y_had)) / (-1 * len(y))

except:

return float('inf')

#计算导数的梯度

def dJ(theta, X_b, y):

return X_b.T.dot(self._sigmoid(X_b.dot(theta)) - y)

def gradient_descent(X_b, y, initial_theta, eta, n_iters=1e4, epsilon=1e-8):

theta = initial_theta

cur_iter = 0

while cur_iter < n_iters:

gradient = dJ(theta, X_b, y)

last_theta = theta

theta = theta - eta * gradient

if (abs(J(theta, X_b, y) - J(last_theta, X_b, y)) < epsilon):

break

cur_iter += 1

return theta

X_b = np.hstack([np.ones((len(X_train), 1)), X_train])

initial_theta = np.zeros(X_b.shape[1])

self._theta = gradient_descent(X_b, y_train, initial_theta, eta=eta, n_iters=n_iters, epsilon=epsilon)

self.intercept_ = self._theta[0]

self.coef_ = self._theta[1:]

return self

def predict_proba(self, X_predict):

"""给定待预测数据集X_predict,返回表示X_predict的结果向量"""

assert self.intercept_ is not None and self.coef_ is not None, \

"must fit before predict!"

assert X_predict.shape[1] == len(self.coef_), \

"the feature number of X_predict must be equal to X_train"

X_b = np.hstack([np.ones((len(X_predict), 1)), X_predict])

return self._sigmoid(X_b.dot(self._theta))

def predict(self, X_predict):

"""给定待预测数据集X_predict,返回表示X_predict的结果向量"""

assert self.intercept_ is not None and self.coef_ is not None, \

"must fit before predict!"

assert X_predict.shape[1] == len(self.coef_), \

"the feature number of X_predict must be equal to X_train"

proba = self.predict_proba(X_predict)

return np.array(proba >= 0.5, dtype=int)

def score(self, X_test, y_test):

"""根据测试数据集 X_test 和 y_test 确定当前模型的准确度"""

y_predict = self.predict(X_test)

return accuracy_score(y_test, y_predict)

def __repr__(self):

return 'LogisitcRegression()'

③课程思考

- 逻辑回归没有正规数学方程解 只可以用梯度下降法求解

- 上面第三部分和第二部分之前其实还有我的手记,记录求解逻辑回归的损失函数,和损失函数的单个导数,在映射到整体训练集,并通过梯度下降对损失函数进行最小化操作,从而使参数达到最优值,从而拟合出就这个数据而言,合适的模型。

- 我发现有时候语言很苍白,但是用数据来表达就会很有条理和清晰,比如我想让一个[-inf,+inf]的值域的数据,变到[0,1]用语言来表述会很冗杂,但是用公式并且可视化,就会非常的清楚。

④课程截图

点击查看更多内容

1人点赞

评论

共同学习,写下你的评论

评论加载中...

作者其他优质文章

正在加载中

感谢您的支持,我会继续努力的~

扫码打赏,你说多少就多少

赞赏金额会直接到老师账户

支付方式

打开微信扫一扫,即可进行扫码打赏哦