-

Python操作mysql步骤3

查看全部 -

Python操作mysql使用步骤2

查看全部 -

Python操作mysql使用步骤

查看全部 -

存储数据到MySQL

查看全部 -

beautiful soup

www.crummy.com/software/BeautifulSoup/#Download

查找修改树形结构,提供一些工具,可以解析文档

默认Unicode,utf-8

支持lxml和html5lib解析器

文档地址:https://www.crummy.com/software/BeautifulSoup/bs4/doc.zh/#id4

查看全部 -

urllib使用post方式

查看全部 -

urllib使用POST方式发送数据

查看全部 -

模拟浏览器 携带User-Agent头

req = request.Request(url)

req.add_header(key, value)

resp = request.urlopen(req)

print(resp.read().decode("utf-8"))

查看全部 -

urllib库的使用步骤

查看全部 -

urllib的用法

查看全部 -

安装BeautifulSoup4

查看全部 -

检查是否安装成功

查看全部 -

检验python及其他是否安装成功

查看全部 -

安装完python后,再安装beautifulsoup4

查看全部 -

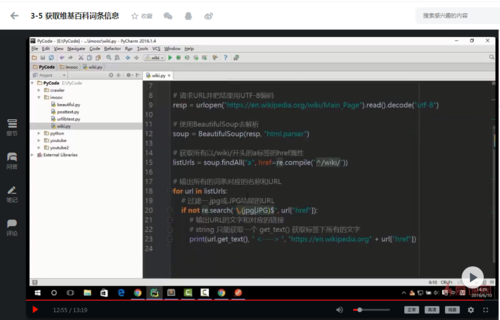

from url.requst import urlopen

from bs4 import BeautifulSoup

import re

#获取网页源代码

resp= urlopen("https://en.wikipedia.org/wiki/Main_Page").read().decode("utf-8")

#解析?网页

soup = BeautifulSoup(resp."html.parse")

#获取所有以/wiki/开头的链接

urls = soup.findAll('a',href=re.compeil("^/wiki/"))

#获取链接内容

for uls in urls:

if not re.search("/.(jpg|JPG)$",url["href"])

print(url.get_text(),url["href"])

查看全部

查看全部

举报