-

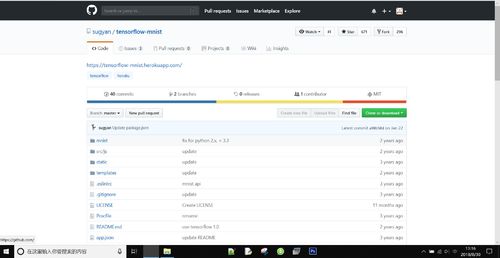

源代码下载:

https://github.com/sugyan/tensorflow-mnist

查看全部

查看全部 -

TensorFlow是什么:

谷歌基于DistBelief进行研发的第二代人工智能学习系统

可被用于语音识别或图像识别等多项机器学习和深度学习领域

是将复杂的数据结构传输至人工智能神经网中进行分析和处理过程的系统

支持CNN、RNN、LSTM算法(目前在IMage,Speech和NLP最流行的深度神经网络模型)

查看全部 -

1.线性模型和卷积模型都已经训练完成,现在需要暴露接口供前端界面调用。

2.如何编写接口呢?写在main.py:

import numpy as np

import tensorflow as tf

from flask import Flask, jsonify, render_template, request

from mnist import model

x = tf.placeholder('float', [None, 784]) # 声明输入

sess = tf.Session() # 定义一个Session

# 拿线性回归模型,ckpt

with tf.variable_scope('regression'):

y1, variables = model.regression(x)

saver = tf.train.Saver(variables)

saver.restore(sess, 'mnist/data/regression.ckpt') # 通过restore方法把模型文件拿出来

# 拿卷积模型和线性同样的方法

with tf.variable_scope('convolutional'):

keep_prob = tf.placeholder('float')

y2, variables = model.convolutional(x, keep_prob)

saver = tf.train.Saver(variables)

saver.restore(sess, 'mnist/data/convolutional.ckpt')

def regression(input):

return sess.run(y1, feed_dict={x: input}).flatten().tolist() # 转换成list

def convolutional(input):

return sess.run(y2, feed_dict={x: input, keep_prob: 1.0}).flatten().tolist()

# 以上步骤之后,两个模型的输入以及如何把数据喂进来以及如何跑这个模型已经完成

# 做接口,用Flask

app = Flask(__name__)

@app.route('/api/mnist', methods=['post']) # 定义一个注解,路由,表示前端传进来之后应该用哪个接口

def mnist():

input = ((255 - np.array(request.json, dtype=uint8)) / 255.0).reshape(1, 784) # 做一个数组的换算,我们模型定义的形状就是1*784的形状

output1 = regression(input)

output2 = convolutional(input)

return jsonify(results=[output1, output2]) # 把结果封装一下

# 定义一个方法来启动它

if __name__ == '__main__':

app.debug = True

app.run(host='0.0.0.0', port=8000)

查看全部 -

1.训练卷积模型和线性模型的基本步骤都是一样的:第一步是定义模型;定义模型之后使用模型,使用模型之后定义一个训练,一次次迭代之后把模型文件ckpt保存下来,以供后续来使用。

2.定义模型:

# 卷积模型:多层卷积

def convolutional(x, keep_prob):

def conv2d(x, W): # 定义一个2*2的卷积

return tf.nn.conv2d([1, 1, 1, 1], padding='SAME')

def max_pool_2x2(x): # 定义一个2*2的池化层

return tf.nn.max_pool(x, ksize=[1, 2, 2, 1], strides=[1, 2, 2, 1], padding='SAME')

def weight_variable(shape): # 定义一个权重变量

initial = tf.truncated_normal(shape, stddev=0.1)

return tf.Variable(initial)

def bias_variable(shape): # 定义一个偏置项变量

initial = tf.constant(0.1, shape=shape)

return tf.Variable(initial)

# 定义卷积层,第一层:

x_image = tf.reshape(x, [-1, 28, 28, 1]) # 定义图像

W_conv1 = weight_variable([5, 5, 1, 32]) # 权重

b_conv1 = bias_variable([32]) # 偏置项

h_conv1 = tf.nn.relu(conv2d(x_image, W_conv1) + b_conv1) # 定义卷积

h_pool1 = max_pool_2x2(h_conv1) # 定义池化

# 第二层实际上和第一层是一样的

查看全部 -

1.线性模型:

# Y = W * x + b

def regression(x):

W = tf.Variable(tf.zeros([784, 10], name='W')) # 784 * 10的二维数组

b = tf.Variable(tf.zeros([10]), name='b') # 一维数组里面放10个值

y = tf.nn.softmax(tf.matmul(x, W) + b) # softmax做简单的线性运算

return y, [W, b]

2. 定义完模型之后引入模型和训练:

# create model

with tf.variable_scope('regression'): # 命名

x = tf.placeholder(tf.float32, [None, 784]) # x:待用户输入,用一个占位符,placeholder的第一个参数是类型,第二个是张量,其中的784是和model中对应

y, variables = model.regression(x)

# train

y_ = tf.placeholder('float', [None, 10])

cross_entropy = -tf.reduce_sum(y_ * tf.log(y)) # 训练的交叉熵

train_step = tf.train.GradientDescentOptimizer(0.01).minimize(cross_entropy) # 训练步骤,GradientDescentOptimizer(0.01):一个优化器,设置步长为0.01

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(y_, 1)) # 预测

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32)) # 准确率,tf.cast(correct_prediction, tf.float32):转换格式

查看全部 -

1. 自从2016年谷歌的alpha-go战胜了世界围棋冠军之后,机器学习和人工智能领域就变得异常火爆。从最早的苹果的Siri到智能垃圾邮件处理,再到微软的一些语音,还有谷歌的在线翻译都是人工智能、深度学习在后台起到至关重要的作用。人工智能在生活中无处不在。比如手机的语音识别,微信里说一句话可以翻译成很多字。现在人工智能取代了一些人力劳动,比如扫地机器人。

2. 课程背景:人工智能和深度学习相关领域的崛起

人工智能的实际应用需求

人工智能与现有技术的结合

查看全部 -

cnn,卷积神经网络, 用于图像识别,rnn,循环神经网络,用于文本识别,文本处理,语义识别,lstm是rnn变种

查看全部 -

TensorFlow框架介绍

查看全部 -

<script>

console.log('hello world');

</script>

查看全部 -

技术再牛逼,口才也很重要查看全部

-

1、轻量级

2、python语言进行编写

训练步骤:

1、下载数据集

2、编写训练程序

3、训练模型

4、验证训练的模型

调用步骤

1、使用训练好的模型

2、定义参数

3、通过端进行传参(web前端页面、绘图仪、手写板)

4、数据验证并返回

暴露接口

可以使用TensorFlow Serving部署成grpc模式的接口

flask

整合步骤

1、训练生成模型

2、暴露接口

3、前端调用

4、验证并返回结果

查看全部 -

完成了使用flask创建api接口,调用训练好的网络

进行网页端的手写数字识别

查看全部 -

通过链接前端的界面

实现了卷积神经网络实时分类输入的手写数字

使用(255-x)/255将0到255的值转化到0到1之间

查看全部 -

在flask中注册api的url

来调用训练好的模型

@app.route('/api/mnist', methods=['post']) def mnist(): input = ((255 - np.array(request.json, dtype=np.uint8)) / 255.0).reshape(1, 784) output1 = regression(input) output2 = convolutional(input) return jsonify(results=[output1, output2]) if __name__ == '__main__': app.run()查看全部 -

完成卷积神经网络的训练

with tf.Session() as sess: merged_summary_op = tf.summary.merge_all() summary_writer = tf.summary.FileWriter('/tmp/mnist_log/1', sess.graph) summary_writer.add_graph(sess.graph) sess.run(tf.global_variables_initializer()) for i in range(20000): batch = data.train.next_batch(50) if i % 100 == 0: train_accuracy = accuracy.eval(feed_dict={x: batch[0], _y: batch[1], keep_prob: 1.0}) print("step %d, train accuracy=%d" % (i, train_accuracy)) sess.run(train_step, feed_dict={x: batch[0], _y: batch[1], keep_prob: 0.5}) print(sess.run(accuracy, feed_dict={x: data.test.images, _y: data.test.labels, keep_prob: 1.0})) path = saver.save(sess, os.path.join(os.path.dirname(__file__), 'data', 'convalution.ckpt'), write_meta_graph=False, write_state=False) print("Saved:", path)查看全部

举报