-

soup = bs(html_doc,"html.parse")

print(soup.title.string)#当title不止一个时会报错

print(soup.title.get_text())

print(soup.a)

print(soup.find(id="link2").get_text)

print(soup.find(id="link2").string)

#print(soup.findAll("a").string)

for link in soup.findAll("a"):

print(link.string)print(soup.find("p",{"class":"story"}))

查看全部 -

post是应用在响应对象中(即要求你下指令之后网页响应的信息)

谷歌内可以使用postman进行查看你想要响应的对象内容是什么

查看全部 -

反爬虫还有一个:origin

查看全部 -

携带请求头的爬虫是最简单的反爬虫的方法:

rep = requst.Requst(url)

rep.add_header(key,value)

resp = request.urlopen(req)

print(resp.read().decode("utf-8")

查看全部 -

读取文件方式

查看全部 -

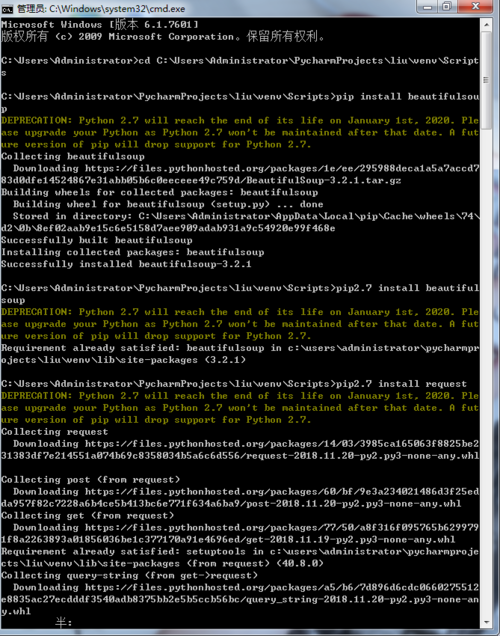

Python安装pip

查看全部

查看全部 -

使用post2

查看全部 -

使用post1

查看全部 -

模拟浏览器访问

查看全部 -

urllib

查看全部 -

Python3字符串默认使用Unicode编码,所以Python3支持多语言。

以Unicode表示的str通过encode()方法可以编码为指定的bytes。

如果bytes使用ASCII编码,遇到ASCII码表没有的字符会以\x##表示,此时只用'\x##'.decode('utf-8')就可以了

查看全部 -

发送POST请求

查看全部 -

携带header

查看全部 -

from urllib import request resp = request.urlopen("http://www.baidu.com") print(resp.read().decode("utf-8"))查看全部 -

urllib库

查看全部

举报